Armas autônomas: o que você precisa saber

As armas autônomas não são uma invenção de ficção científica de um futuro distópico distante. São um motivo imediato de preocupação humanitária e exigem uma resposta política internacional urgente. O assessor científico e de políticas do CICV, Neil Davison, explica.

O que é uma arma autônoma?

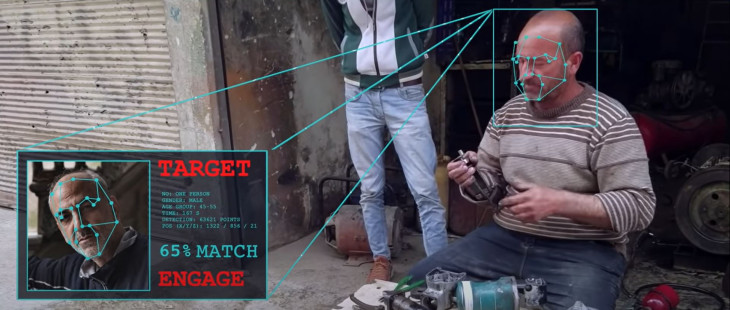

O CICV considera que os sistemas de armas autônomas são as armas que selecionam os alvos e fazem uso da força sem intervenção humana. Uma pessoa ativa uma arma autônoma, mas não sabe especificamente quem ou o que vai atacar, nem exatamente onde e/ou quando esse ataque ocorrerá. Uma arma autônoma é acionada por sensores e software que fazem uma equivalência entre o que os sensores detectam no ambiente e um "perfil de alvo". Este perfil pode ser, por exemplo, o formato de um veículo militar ou o movimento de uma pessoa. Portanto, é o veículo ou a vítima que aciona o ataque, não o usuário.

Nossa preocupação com esse processo é que se perde o julgamento humano no uso da força. Fica difícil controlar as consequências do uso dessas armas. Ao ativar a arma, como o usuário pode saber se o formato que aciona o ataque será de fato um veículo militar e não um carro civil? Mesmo que o ataque atinja um veículo militar, e se houver pessoas civis por perto naquele momento?

Quando essas armas vão existir?

Minas podem ser consideradas uma versão rudimentar das armas autônomas. Os graves danos que elas causaram à população civil em muitos conflitos – porque seus efeitos são difíceis de controlar – estão bem documentados. Isso levou a comunidade internacional a proibir as minas antipessoais em 1997.

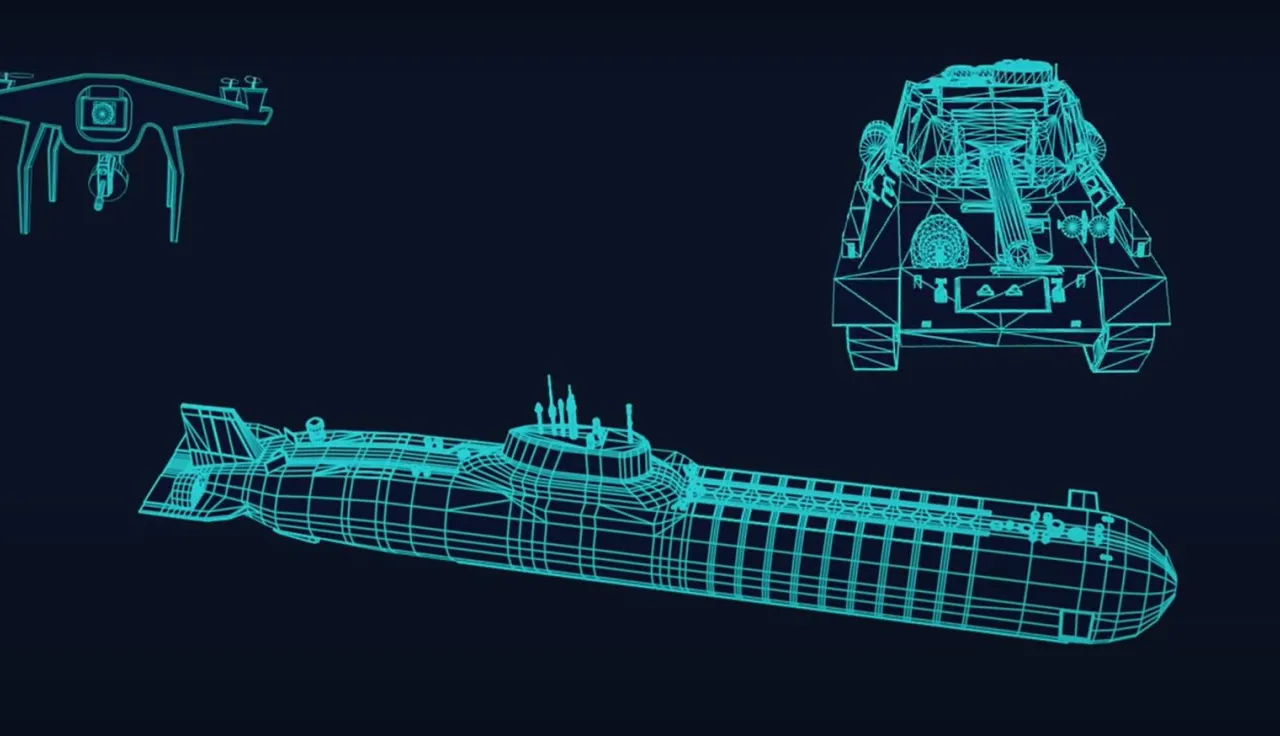

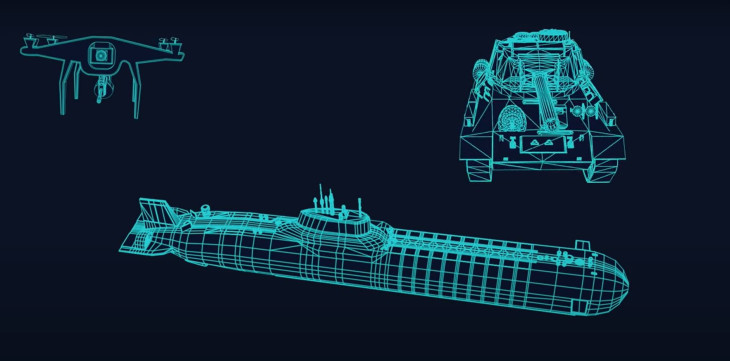

Outros tipos de armas autônomas também foram criados, mas tendem a ser usados apenas em circunstâncias muito restritas. Alguns exemplos são os sistemas de defesa aérea que atingem os mísseis que se aproximarem e os chamados "drones suicidas", também conhecidos como "drones kamikaze", criados para destruir radares militares, tanques ou veículos blindados. Até o momento, essas armas autônomas geralmente têm sido usadas contra alvos militares claros – como armas e munições, radares militares e tanques inimigos – em áreas onde há poucos civis ou bens de caráter civil. Também tendem a estar sob uma supervisão humana rigorosa, com a capacidade de desligá-las se a situação mudar ou se algo inesperado acontecer. No entanto, tanto as tecnologias das armas quanto as práticas estão mudando rapidamente. A indústria bélica e militar está interessada em integrar a automatização do uso da força a uma maior variedade de armas, plataformas e munições, inclusive aos drones armados que atualmente são controlados de forma remota por operadores humanos. Ainda mais preocupante, há interesse em usar armas autônomas para atingir diretamente seres humanos.

Por que as armas autônomas preocupam o CICV?

Em poucas palavras, elas representam riscos humanitários, desafios jurídicos e preocupações éticas devido à dificuldade de prever e de limitar seus efeitos.

Conforme mencionado acima, elas aumentam os perigos enfrentados pela população civil enquanto os soldados deixam de participar do combate, ou seja, aqueles que se renderam ou estão feridos também enfrentam riscos maiores. As armas autônomas também podem acelerar o uso da força a ponto de impedir o controle humano. Embora a velocidade possa ser vantajosa para os militares em algumas circunstâncias, se estiver descontrolada, ela poderia escalar os conflitos de um modo imprevisível e agravar as necessidades humanitárias.

Desafios jurídicos

O Direito Internacional Humanitário exige que os combatentes, ao realizar um ataque específico, façam julgamentos jurídicos avaliativos e de acordo com o contexto.

O modo de funcionamento das armas autônomas torna isso difícil, porque o usuário não escolhe o alvo específico nem a hora e o local exatos de um ataque. Em que condições os operadores de uma arma autônoma poderiam ter a certeza de que ela só será acionada por coisas que efetivamente sejam alvos lícitos naquele momento e que não resultarão em danos desproporcionais para a população civil?

As armas autônomas também criam dificuldades em termos de responsabilidade jurídica. Quando o Direito Internacional Humanitário é violado, é crucial responsabilizar os autores para fazer justiça às vítimas e para dissuadir outras infrações. Normalmente, as investigações buscam a pessoa que disparou a arma e a pessoa do comando que deu a ordem de atacar.

Com o uso de armas autônomas, quem vai explicar por que uma arma autônoma atingiu um ônibus civil, por exemplo?

Há muitas dúvidas de que os supostos autores de crimes de guerra possam ser responsabilizados pelos regimes jurídicos existentes.

Preocupações éticas

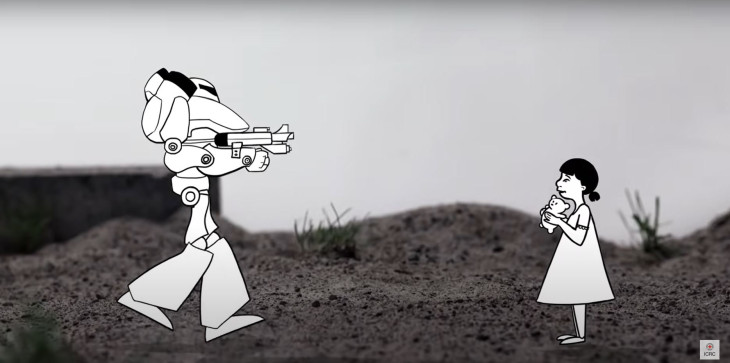

Mais fundamentalmente, há muitas preocupações sérias sobre ceder decisões de vida ou morte para sensores e software.

Os seres humanos têm uma consciência moral que orienta suas decisões e ações, inclusive nos conflitos em que as decisões de matar estão, de certo modo, normalizadas.

As armas autônomas reduzem – e poderiam chegar a eliminar – a consciência humana nas decisões de matar, ferir e destruir. Este é um processo desumanizador que enfraquece nossos valores e nossa humanidade compartilhada.

Todas as armas autônomas que colocam seres humanos em perigo impõem essas preocupações éticas, mas elas são particularmente agudas com armas projetadas ou usadas para atingir diretamente os seres humanos.

Qual é o papel da IA e da aprendizagem de máquina nas armas autônomas?

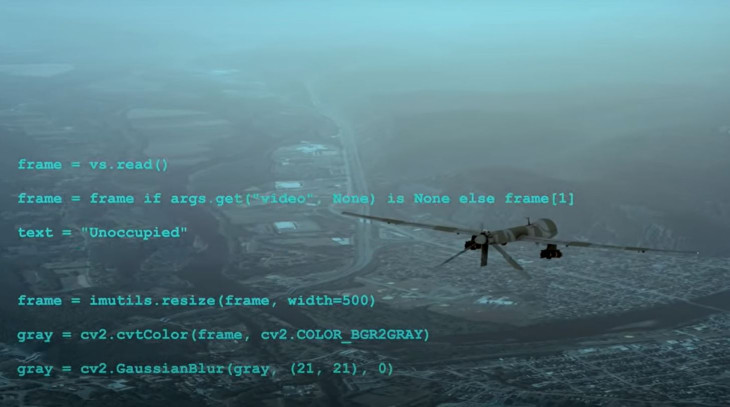

Há cada vez mais interesse em confiar na inteligência artificial, particularmente na aprendizagem de máquina, para controlar armas autônomas.

O software de aprendizagem de máquina é "treinado" com dados para criar seu próprio modelo de uma tarefa específica e as estratégias para concluir essa tarefa. De certa forma, o software escreve a si mesmo.

Com frequência, este modelo será uma "caixa preta": vai ser extremamente difícil para os seres humanos prever, compreender, explicar e testar como – e com base em quê – um sistema de aprendizagem de máquina chegará a uma avaliação ou a um resultado específico.

Como é bem sabido por diversos usos, como o policiamento, os sistemas de aprendizagem de máquina também preocupam devido ao preconceito embutido na codificação, inclusive em termos de raça, gênero e sexo.

Com todas as armas autônomas, pode ser muito difícil para um usuário prever as consequências. Como mencionado acima, o usuário talvez nem saiba o que desencadeará um ataque. As armas autônomas controladas por aprendizagem de máquina aumentam essa preocupação. Elas trazem a perspectiva de que as armas sejam concebidas para ser imprevisíveis.

Alguns sistemas de aprendizagem de máquina continuam "aprendendo" durante o uso – são os chamados sistemas "ativos", "on-line" ou "de autoaprendizagem" –, o que significa que o modelo de tarefa muda com o tempo.

No caso das armas autônomas, se o sistema pudesse "aprender" a identificar alvos durante seu uso, como o usuário poderia ter certeza de que o ataque seria realizado dentro dos limites do que é legalmente permitido na guerra?

O que o CICV recomenda que os governos e outros façam?

O CICV recomendou que os Estados adotem novas normas juridicamente vinculantes sobre armas autônomas. As novas normas ajudarão a prevenir riscos graves de danos para a população civil e a dar respostas a preocupações éticas. Além disso, elas oferecem o benefício da segurança jurídica e da estabilidade.

Primeiro, as armas autônomas imprevisíveis devem ser proibidas. Isso se refere às armas autônomas que são projetadas ou usadas de modo que seus efeitos não possam ser suficientemente compreendidos, previstos e explicados – inclusive aquelas que "aprendem" alvos durante o uso e talvez as armas autônomas controladas por aprendizagem de máquina em geral.

Segundo, as armas autônomas que são projetadas e usadas para fazer uso da força diretamente contra pessoas devem ser proibidas.

Terceiro, é necessário que haja restrições rígidas à criação e ao uso de todas as outras armas autônomas a fim de mitigar os riscos mencionados acima, garantir o cumprimento da lei e lidar com as questões éticas.

Como guardião do Direito Internacional Humanitário, o CICV não recomenda que novas normas sejam criadas de maneira inconsequente.

No entanto, também estamos empenhados em fomentar o desenvolvimento progressivo da legislação para garantir que as normas existentes não sejam prejudicadas. Queremos garantir que as proteções para as pessoas afetadas por conflitos sejam mantidas e, quando necessário, reforçadas diante da evolução das armas e dos métodos de guerra.

Assim como acontece com as minas terrestres antipessoais, as armas cegantes a laser e as bombas cluster, precisamos de um novo tratado juridicamente vinculante para proteger a população civil e os combatentes. A humanidade deve ser preservada na guerra.

Estas normas poderiam ser estabelecidas num novo Protocolo à Convenção sobre Certas Armas Convencionais (CCAC) ou em outro instrumento juridicamente vinculante.

O CICV considera que novas normas serão adotadas?

Temos convicção de que os Estados concordarão com novas normas internacionais sobre as armas autônomas. A maioria dos Estados reconhece a necessidade de assegurar certo grau de julgamento e de controle humano no uso da força, o que significará impor restrições rigorosas às armas autônomas.

Um número cada vez maior de Estados está pronto para adotar proibições e restrições específicas. Outros reconhecem a necessidade destes limites, mesmo que ainda não se tenham comprometido com novas normas.

Alguns dos Estados que anteriormente se opunham a novas normas estão mostrando-se mais abertos, talvez impulsionados por discussões multilaterais mais aprofundadas e por acontecimentos em conflitos recentes. Soluções plausíveis e pragmáticas estão sendo discutidas para regulamentar as armas autônomas. Os atuais avanços e práticas da tecnologia militar tornam urgente que elas sejam adotadas.

Agora, é necessária uma liderança política de princípios por parte dos Estados para apresentar essa solução em um instrumento juridicamente vinculante que proteja as pessoas durante muito tempo.